小扎拆骨Thinking Machines!120亿美元AI独角兽第5位创始人跳槽Meta

小扎拆骨Thinking Machines!120亿美元AI独角兽第5位创始人跳槽Meta人才奇点先于AGI到来!Meta狂挖Mira Murati120亿估值公司,第5人正式就位。巨头不再买公司,而是直接买大脑——这场抢人大战,让所有AI创业者后背发凉。

人才奇点先于AGI到来!Meta狂挖Mira Murati120亿估值公司,第5人正式就位。巨头不再买公司,而是直接买大脑——这场抢人大战,让所有AI创业者后背发凉。

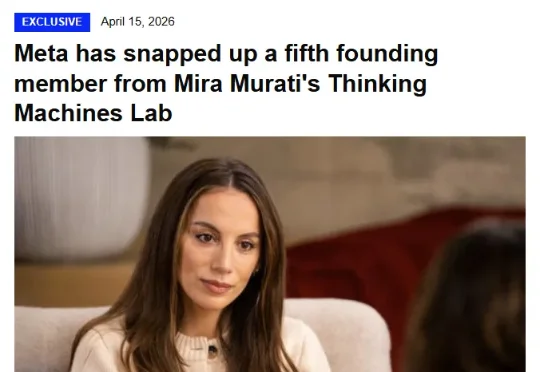

又给算力又投资,英伟达又有一大笔资源砸向了Mira的初创公司。

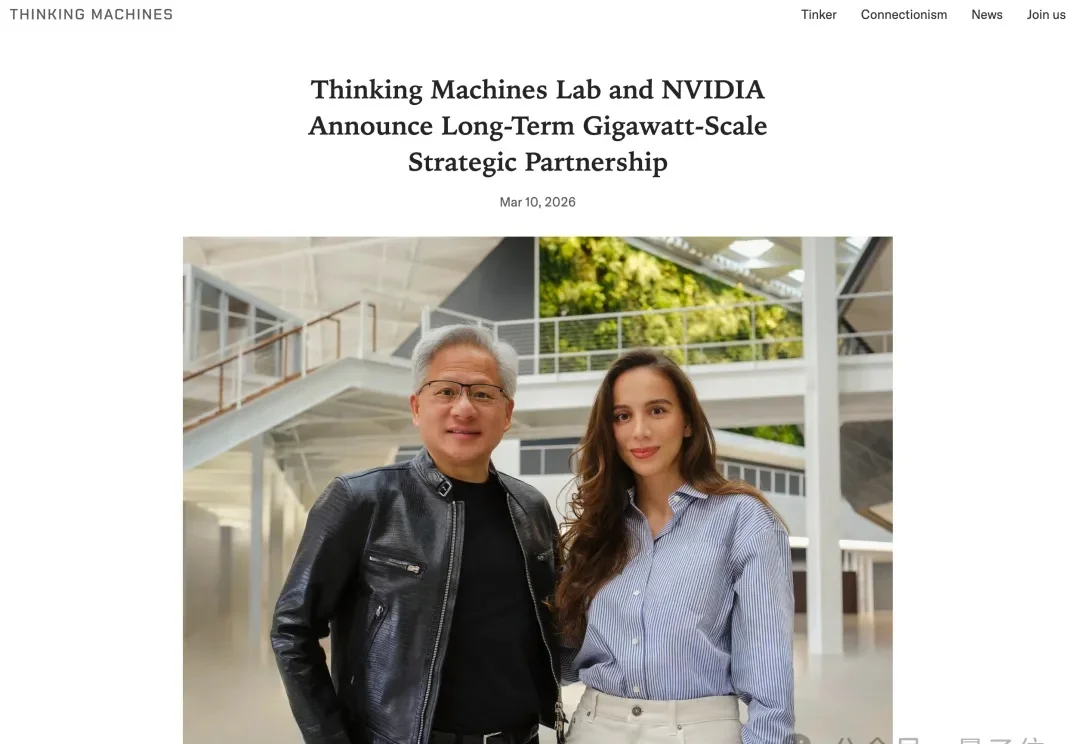

昨天,Thinking Maching Lab 研究者、斯坦福大学博士生 Zitong Yang 正式完成了他的博士论文答辩,课题为「持续自我提升式 AI」(Continually self-improving AI),并且他在答辩完成后很快就放出了自己的答辩视频,从中我们可以看到他对未来 AI 发展路径的系统性探索。

陈丹琦首次转身工业界,第一站就选择Mira初创的理由找到了—— 有个赛友也在这儿,还足足“潜伏”了一年之久。

2026年1月,前OpenAI CTO Mira Murati创办的明星公司Thinking Machines Lab遭遇「灭顶之灾」:联合创始人Barret Zoph因办公室恋情丑闻被降职后心生不满,联合另外两名核心骨干向Mira逼宫索权,遭拒后被当场开除。然而仅不到一小时,三人便集体叛逃回OpenAI,在老东家的迎接下风光回朝。

1 月 14 日下午,Thinking Machines Lab 正在召开全员大会。CEO Mira Murati 站在前面,宣布了一个令所有人震惊的消息:公司已解除联合创始人兼首席技术官 Barret Zoph 的职务,原因是“不道德行为”。会议还没结束,公司 Slack 上又炸了两颗雷,另一位联合创始人 Luke Metz 和创始团队成员 Sam Schoenholz 几乎同时发帖宣布离职。

继奥特曼在 OpenAI 的「宫斗」大戏后,他的老搭档 Mira 这周的经历也够拍一部电视剧了。我们报道了前 OpenAI CTO Mira Murati 创办的 Thinking Machines Lab 出现重大人事变动的消息:联合创始人兼 CTO Barret Zoph 被解雇,另一位联创 Luke Metz 以及创始团队成员 Sam Schoenholz 也一起离开

美团也重磅更新自家模型 ——LongCat-Flash-Thinking-2601。这是一款强大高效的大规模推理模型,拥有 5600 亿个参数,基于创新的 MoE 架构构建。该模型引入了强大的重思考模式(Heavy Thinking Mode),能够同时启动 8 路思考并最终总结出一个更全面、更可靠的结论。目前重思考模式已在 LongCat AI 平台正式上线,人人均可体验。

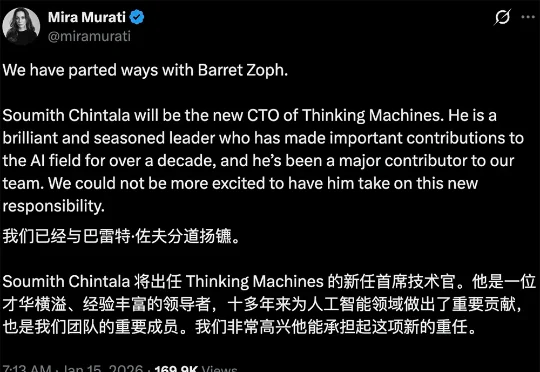

估值 120 亿美元的明星 AI 公司,创业没几年就把首任 CTO 给开了。就在刚刚,前 OpenAI CTO、Thinking Machines Lab 创始人 Mira Murati 在社交媒体上发了条措辞相当严厉的声明:

今早,媒体人Kylie Robison在社交平台X上发文称,据两位知情人士消息,由前OpenAI首席技术官Mira Murati共同创立的知名AI创企Thinking Machines Lab已解雇其首席技术官Barret Zoph,因其“不道德行为”。